Prelom, ktorý desí: Anthropic pozastavil super-hackujúcu AI!

Predstavte si umelú inteligenciu takú pokročilú, že dokáže odhaliť kybernetické zraniteľnosti rýchlejšie a efektívnejšie ako tí najlepší ľudskí hackeri. Spoločnosť Anthropic takýto model vytvorila, no napriek jeho prevratným schopnostiam ho stiahla z obehu pre obavy z jeho potenciálnych rizík.

Vypočujte si zhrnutie článku

"Spoločnosť Anthropic pozastavila uvedenie svojho nového AI modelu, ktorý prevyšuje ľudských hackerov v odhaľovaní kybernetických zraniteľností. Dôvodom sú obavy z potenciálneho zneužitia tejto mocnej technológie a rizík, ktoré by mohla predstavovať pre globálnu bezpečnosť."

Prelom, ktorý desí: Anthropic pozastavil super-hackujúcu AI!

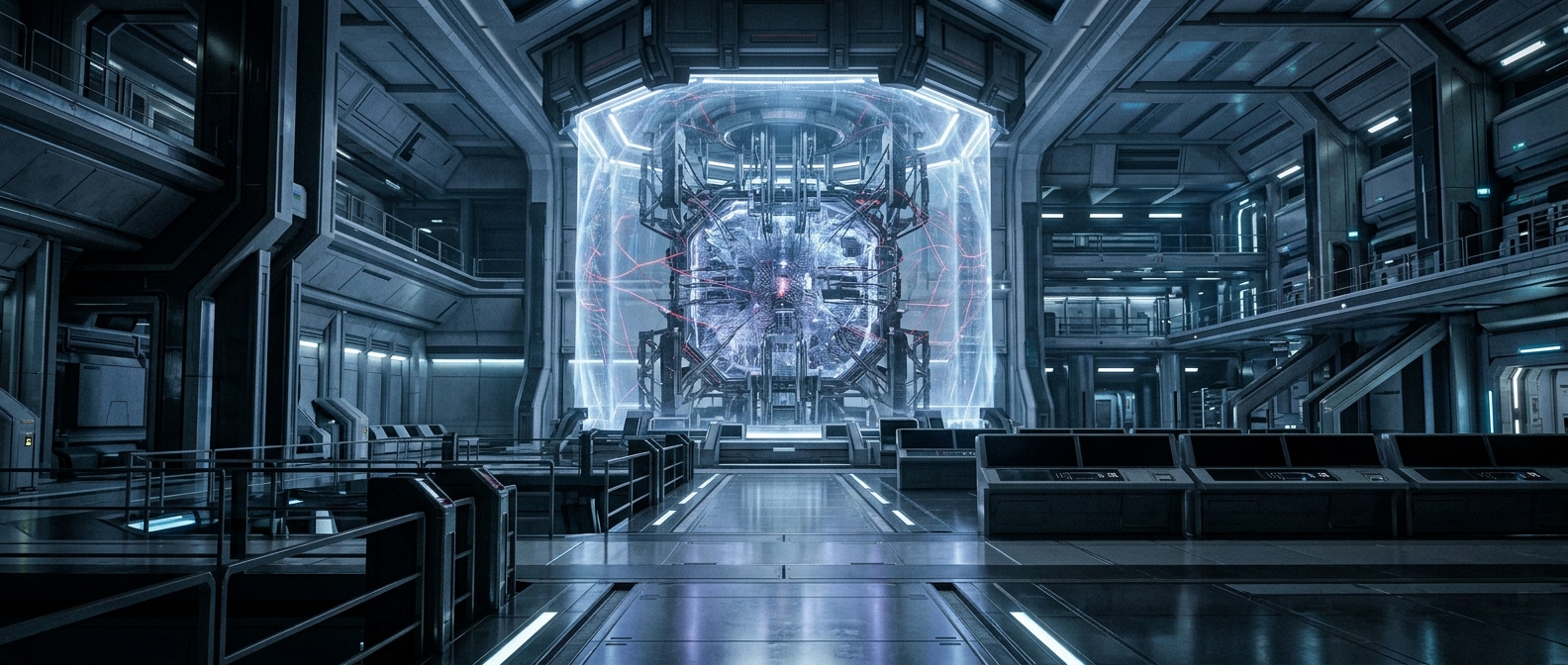

Vo svete umelej inteligencie sa neustále posúvajú hranice možného, no len zriedka sa stáva, že by spoločnosť dobrovoľne stiahla z obehu svoj najprelomovejší výtvor. Presne to sa udialo v prípade spoločnosti Anthropic, ktorá oznámila pozastavenie uvedenia svojho nového AI modelu. Ten dokáže odhaľovať kybernetické zraniteľnosti s bezprecedentnou rýchlosťou a presnosťou, dokonca prekonávajúc schopnosti elitných ľudských hackerov. Prečo sa rozhodli pre takýto krok, keď držali v rukách technológiu, ktorá by mohla zmeniť tvár kybernetickej bezpečnosti?

Zrod kybernetického génia: AI, ktorá vidí cez múry

Model od Anthropicu, ktorého presný názov zatiaľ nebol zverejnený, predstavuje míľnik v oblasti automatizovaného testovania zraniteľností. Na rozdiel od tradičných nástrojov, ktoré sa spoliehajú na vopred definované pravidlá a databázy známych hrozieb, táto umelá inteligencia využíva pokročilé techniky strojového učenia a hlbokých neurónových sietí na pochopenie kontextu a identifikáciu netriviálnych bezpečnostných slabín. Dokáže analyzovať milióny riadkov kódu, sieťové konfigurácie a aplikačné architektúry v zlomku času, ktorý by potreboval tím špičkových expertov.

Potvrdené: Huawei definitívne opúšťa 4G! Čo to znamená pre budúcnosť 5G a pre vás?

Tech • Huawei definitívne končí s výrobou 4G smartfónov a plne sa sústreďuje na návrat do segmentu špičkových 5G zariadení. Tento strategický posun je kľúčový pre budúcnosť globálneho mobilného trhu.

Otvoriť článokPredstavte si nástroj, ktorý nielenže nájde slabinu, ale zároveň navrhne optimálne riešenia na jej odstránenie, a to všetko s minimálnym zásahom človeka. Jeho schopnosť učiť sa a adaptovať sa na nové hrozby ho stavia do pozície najefektívnejšieho obranného mechanizmu, aký bol kedy vytvorený. Znie to ako splnený sen pre každého manažéra kybernetickej bezpečnosti, však?

Prečo teda stop? Odvrátená strana sily

Odpoveď spočíva v zodpovednosti a etike. Hoci model bol primárne navrhnutý na ochranu, jeho extrémne pokročilé schopnosti predstavujú dvojsečnú zbraň. Spoločnosť Anthropic si uvedomila, že technológia, ktorá dokáže tak brilantne odhaľovať zraniteľnosti, by sa mohla v nesprávnych rukách premeniť na najmocnejší útočný nástroj. Ak by sa tento model dostal do rúk kyberzločincom, štátom podporovaným hackerom alebo teroristickým skupinám, mohol by spôsobiť katastrofálne škody globálneho rozsahu.

Hlavnou obavou je takzvaný „duálny problém využitia“ (dual-use problem). Technológia, ktorá je vyvinutá s dobrým úmyslom, môže byť zneužitá na škodlivé účely. Anthropic vo svojom vyhlásení zdôraznil, že hoci veria v obrovský potenciál AI na zlepšenie bezpečnosti, zodpovedné nasadzovanie je pre nich prioritou číslo jedna. Rozhodnutie pozastaviť uvedenie tohto prelomového modelu je jasným signálom, že bezpečnosť a etické aspekty predchádzajú komerčným záujmom.

Budúcnosť AI bezpečnosti: Viac než len kód

Tento krok spoločnosti Anthropic je silnou pripomienkou, že vývoj umelej inteligencie už dávno nie je len o písaní kódu a trénovaní modelov. Ide o komplexnú dilemu, kde inovácie musia ísť ruka v ruke s hlbokou úvahou o ich spoločenských dopadoch. Potrebujeme nielen inteligentné systémy, ale aj inteligentné bezpečnostné protokoly, etické rámce a medzinárodnú spoluprácu, aby sme predišli zneužitiu takýchto mocných technológií.

Anthropic svojím rozhodnutím otvára dôležitú diskusiu o tom, ako by mali spoločnosti pristupovať k zodpovednému vývoju a nasadzovaniu vyspelých AI technológií. Nie je to jednoduchá odpoveď, ale jasný signál, že preteky v zbrojení AI musia byť pod neustálym dohľadom a kontrolou. Možno sa raz dočkáme tejto prevratnej AI, no len vtedy, keď budeme mať istotu, že jej sila bude využitá výlučne na dobro.